Google Translate Dikeluhkan Berlaku Seksis

KOMPAS.com - Aplikasi alih bahasa Google Translate dianggap melakukan praktik diskriminasi berdasarkan gender atau jenis kelamin (seksis) saat melakukan penerjemahan kalimat. Kasus ini pertama kali ditemukan oleh seorang penulis yang bekerja di Universitas Chicago, Alex Shams.

Pada awalnya, Shams mencoba mengetikkan beberapa kalimat sederhana, seperti "dia adalah seorang dokter" dan "dia adalah seorang perawat" dengan menggunakan bahasa Turki.

Saat kalimat tersebut diterjemahkan ke bahasa Inggris, Ia pun terkejut. Alasannya, beberapa profesi atau pekerjaan langsung diasosiasikan kepada perempuan. Misalnya untuk pekerjaan mencuci baju dan profesi perawat.

Sedangkan pekerjaan lain seperti programer dan insirnyur diterjemahkan Google sebagai pekerjaan laki-laki. Menurut Shams, sistem penerjemahan pada Google Translate seksis dan bias gender.

Tanpa pikir panjang, Shams pun mengabadikan hasil temuannya melalui tangkapan layar dan menyebarkan penemuan itu melalui akun Twitter miliknya.

"Bahasa Turki merupakan bahasa yang netral terhadap gender. Tidak ada perbedaan antara laki-laki dan perempuan. Tapi, lihat apa yang terjadi ketika aku menerjemahkannya dalam bahasa Inggris," tulis Shams di akun Twitter miliknya. Kicauan ini telah di-retweet sebanyak lebih dari 15.000 kali.

Turkish is a gender neutral language. There is no "he" or "she" - everything is just "o". But look what happens when Google translates to English. Thread: pic.twitter.com/mIWjP4E6xw

— Alex Shams (@seyyedreza) November 27, 2017

Seorang yang penasaran dengan postingan Shams bernama Taika Dahlbom kemudian mencoba sendiri. Wanita asal Finlandia ini menguji alogaritma Google Translate dengan mengetikkan kata "dia" dalam bahasa ibunya.

Sama seperti Shams, Taika lantas menerjemahkan kata tersebut ke dalam bahasa Inggris. Hasilnya, secara keseluruhan kata tersebut diterjemahkan ke dalam bentuk orang ketiga dari laki-laki.

"Lihat, bagaimana seksisme Google Translate. Bahasa Finlandia adalah bahasa netral. Tapi Google memilih untuk memberi gelar berdasarkan pekerjaan mereka," ujar Dahlbom.

Look,how @Google Translate does #sexism! #Finnish has a gender neutral third-person pronoun. But Google decides, if a job title is good to go with the male or the female English third-person pronoun. Idea: @seyyedreza in #Turkish pic.twitter.com/jU9Su0JXd5

— Taika Dahlbom (@TaikaDahlbom) November 28, 2017

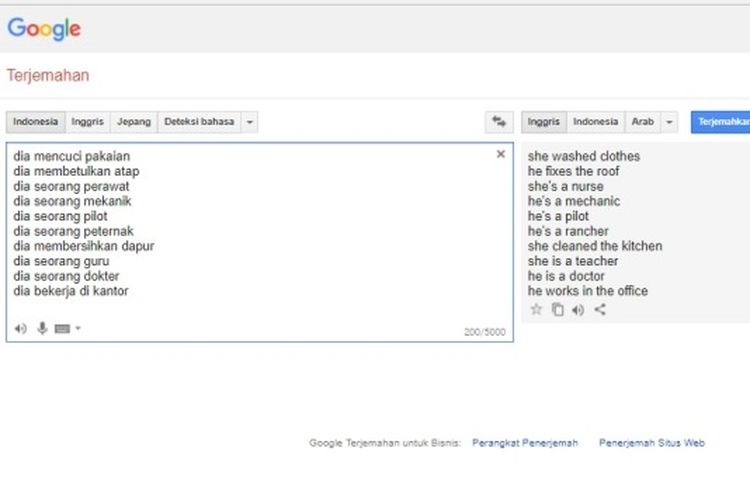

Saat diuji KompasTekno, Google Translate juga menampilkan hasil terjemahan yang sama seperti yang dikeluhkan di atas. Meski hasilnya tidak konsisten. Misalnya saat kalimat "dia seorang kuli bangunan" diterjemahkan, hasilnya adalah "she's a construction worker".

Google Translate sebetulnya menyediakan beberapa opsi hasil terjemahan. Misalnya untuk kalimat "dia sedang memasak" hasil yang ditampilkan adalah "he is cooking" dengan pilihan lain "she is cooking". Meski demikian tidak ada opsi lain untuk terjemahan "dia seorang programer". Hasil terjemahan untuk kalimat itu hanya ada, "he is a programmer".

Menanggapi hal ini, Google masih belum memberikan komentarnya, seperti dikutip KompasTekno dari DailyMail, Jumat (15/11/2017).

Pengaruh algoritma

Selama bertahun-tahun, peneliti maupun pengembang aplikasi berusaha mengembangkan alogaritma dari kecerdasan buatan agar menyerupai manusia. Biasanya, alogaritma itu diadaptasi berdasarkan perilaku dan data yang paling banyak dilakukan dan ditemukan.

Mungkin inilah yang terjadi pada sistem algoritma Google Translate. Di setiap penerjemahan, Google memasukkan sistem algoritma berdasarkan frekuensi dan data yang paling banyak ditemukan.

Misalnya, data mengenai profesi insinyur yang mayoritas dilakukan oleh laki-laki. Sedangkan data mengenai profesi perawat banyak dilakukan oleh perempuan. Maka secara otomatis, Google akan menerjemahkan pekerjaan insinyur sebagai profesi laki-laki sedangkan perawat adalah pekerjaan perempuan.

Perilaku seksi yang terjadi pada aplikasi yang mengusung teknologi algoritma berbasis kecerdasan buatan bukan kali ini saja terjadi.

Sebelumnya, program komputer yang digunakan oleh pengadilan Amerika Serikat, Correctional Offender Management Profiling for Alternative Sanctions (Compas) disebut mengusung unsur bias terhadap tahanan kulit hitam.

Program ini digunakan oleh pengadilan untuk membantu hakim memutuskan sebuah perkara pada seorang terdakwa. Dirangkum, KompasTekno dari The Guardian, program tersebut akan menandai kesalahan orang kulit hitam dua kali lebih banyak dari orang kulit putih.

Menanggapi hal tersebut, pencipta Compas, Northpointe menyangkal pahwa pihaknya melakukan kesengajaan pada saat pemrograman. Meski demikian, Northpointe enggan berkomentar bagaimana cara kerja sistem tersebut.

Simak breaking news dan berita pilihan kami langsung di ponselmu. Pilih saluran andalanmu akses berita Kompas.com WhatsApp Channel : https://www.whatsapp.com/channel/0029VaFPbedBPzjZrk13HO3D. Pastikan kamu sudah install aplikasi WhatsApp ya.-

![]()

Google Translate untuk Bahasa Indonesia Makin Mirip Manusia

-

![]()

Rapat soal Seksis, Direksi Uber Malah Sebut Perempuan Bikin Berisik

-

![]()

YouTuber Ini Bikin Lagu dari Suara Google Translate, Hasilnya?

-

![]()

Peneliti di MIT Ciptakan Stiker Penangkal Pelecehan Seksual

-

![]()

Kakak Perempuan Zuckerberg Jadi Korban Pelecehan di Pesawat