Facebook Bohong soal Jumlah Konten "Hate Speech" yang Dihapus?

KOMPAS.com - Facebook diduga berbohong soal jumlah konten hate speech/ujaran kebencian yang berhasil dihapus dari platformnya.

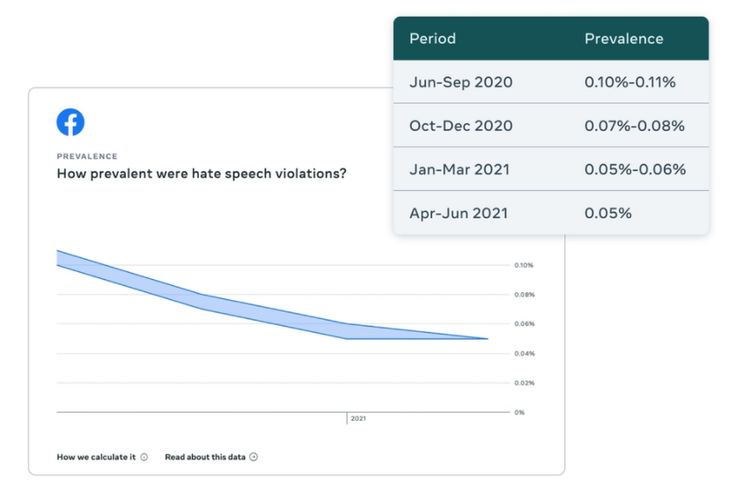

Facebook sendiri menggunakan kombinasi teknologi keceradasan buatan (AI) dan review manusia untuk memerangi ujaran kebencian.

Facebook bahkan mengklaim hampir semua (98 persen) konten hate speech yang dihapus berhasil dideteksi lebih dulu oleh teknologi AI Facebook, sebelum dilaporkan oleh pengguna.

Namun angka tersebut belakangan diragukan validitasnya, sebab bocoran dokumen justru mengungkap bahwa hanya sebagian kecil konten hate speech yang berhasil dideteksi oleh AI Facebook.

Hanya hapus sebagian kecil konten hate speech

Setelah menganalisis dokumen internal Facebook yang bocor, The Wall Street Journal menemukan bahwa hanya sebagian kecil konten hate speech yang berhasil dihapus Facebook.

Baca juga: Daftar Organisasi Berbahaya Versi Facebook Bocor, Ada Nama dari Indonesia

Dalam sebuah dokumen, insinyur senior Facebook yang bertanggung jawab memberantas konten berbahaya (termasuk ujaran kebencian), mengakui bahwa Facebook tidak akan benar-benar dapat memerangi konten-konten seperti itu.

Sebab, pada catatan di pertengahan 2019, insinyur itu memperkirakan deteksi otomatis dengan teknologi AI milik perusahaan hanya mampu menghapus 2 persen dari konten berisi ujaran kebencian di platformnya.

"Perkiraan terbaru menunjukkan bahwa kecuali ada perubahan besar dalam strategi memerangi hate speech, akan sangat sulit untuk meningkatkan persentase tersebut melampaui 10-20 persen dalam jangka pendek-menengah," tulisnya.

Pada Maret 2021 ini, kesimpulan yang sama diungkap oleh karyawan Facebook lainnya, yang mana teknologi AI Facebook diestimasikan hanya berhasil menghapus 3-5 persen tayangan ujaran kebencian di Facebook.

Bila dikalkulasi, persentase tersebut hanya mewakili 0,6 persen dari semua konten yang melanggar kebijakan Facebook di kategori kekerasan dan hasutan.

Baca juga: Begini Cara Facebook Memberantas Konten Berisi Ujaran Kebencian

Dengan kata lain, sebenarnya teknologi AI Facebook ini tidak benar-benar efektif bisa memerangi konten ujaran kebencian di Facebook.

Gantikan reviewer manusia dengan AI

Sebelumnya, CEO Facebook Mark Zuckerberg berharap platformnya dapat menggunakan AI untuk mendeteksi "sebagian besar konten bermasalah" (seperti ujaran kekerasan, penghinaan, ajakan mengucilkan, dsb) pada akhir 2019 lalu.

Menurut dokumen internal, Facebook juga rela memangkas waktu reviewer manusia dengan teknologi AI untuk menghemat biaya operasi.

Ketika itu, setiap tahunnya, Facebook perlu mengeluarkan 104 juta dollar AS per tahun untuk membayar reviwer manusia. Reviewer manusia ini adalah staf yang tugasnya meninjau/menganalisis keluhan konten ujaran kebencian yang dilaporkan langsung oleh pengguna.

Makanya ketika reviewer manusia dikurangi, ini secara otomatis juga mengurangi jumlah keluhan yang berasal langsung dari pengguna Facebook soal konten hate speech.